Om du har en modern dator så kan du skapa AI-bilder lokalt. Helt offline utan att någon kan se vad du gör. Dessutom helt utan att det kostar dig något alls. Stable Diffusion kan verka lite krångligt till en början, men när du väl kommit in i det så är det lite beroendeframkallande. Numera finns det dessutom script som gör det superlätt att installera.

I skrivande stund så är den bästa generatorn för AI-bilder Midjourney, men den kostar pengar att använda. Du måste dessutom vara online på Discord för att kunna använda den. Stable Diffusion är inte riktigt lika bra än, men du kan ladda hem fler modeller från exempelvis Civitai som är tränade på olika sätt (en hel del nsfw där (så klart), men det är blurrat som standard så du törs klicka dig dit).

Själv inväntar jag SDXL från Stability AI som lovar bättre detaljer i bilder som genereras. Den är dock fortfarande i beta och inte släppt för nedladdning ännu, man kan dock testa den i deras DreamStudio. Men jag ska visa dig några exempel på vad man kan göra redan nu med Stable Diffusion v1.5.

Systemkrav och installation

Webbgränssnittet från Automatic1111 (Inte från Stability AI) hittar du på Github. Du behöver ha en GPU från NVIDIA eller AMD, välj installationsfil baserat på vilket grafikkort du har. Med ett NVIDIA 3080 med 10Gb VRAM och en bild i standardstorleken 512×512 pixlar så genereras en ny bild på ett par sekunder. Här nedan kan du hitta länkar till installations-instruktioner.

Installera Stable Diffusion för NVIDIA:

https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Install-and-Run-on-NVidia-GPUs

Installera Stable Diffusion för AMD:

https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Install-and-Run-on-AMD-GPUs

Efter att du installerat Stable Diffusion så kan du starta programmet med filen run.bat (förutsatt att allt gick som det skulle). I terminal-fönstret som öppnas så ser du en massa text och en länk, För att öppna Stable Diffusion i din webbläsare, håller du ner ctrl och vänsterklickar på länken. Standard är http://127.0.0.1:7860/

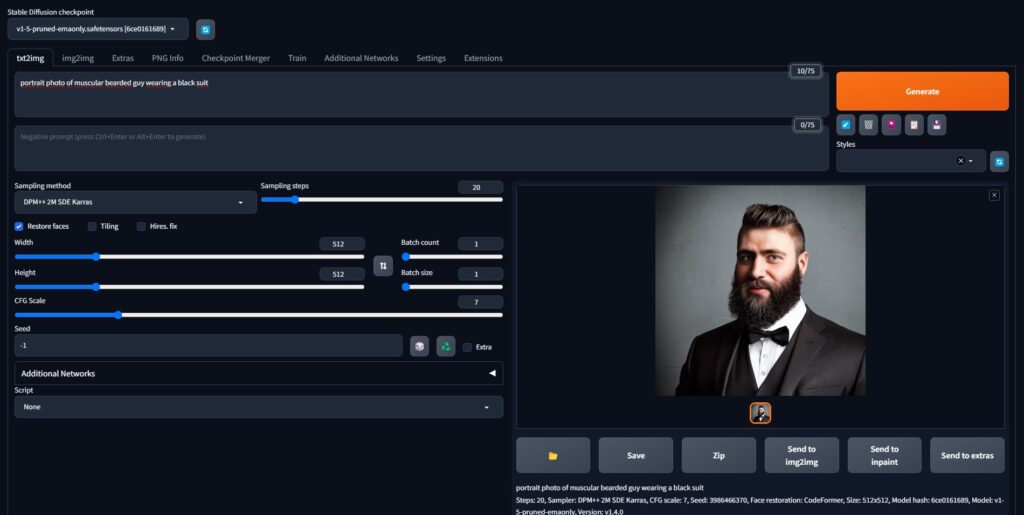

AI-bilder med en prompt

Att berätta för Stable Diffusion vad den ska generera kallas att ge den en prompt. Alla prompter skrivs på engelska, förklara vad du vill att din AI ska rita. Till exempel om man vill ha ett porträtt av en muskulös skäggig man i kostym så skriver man bara det på engelska och trycker sedan på ”Generate”. Sen tar det några sekunder och voilá så har du en bild på precis det!

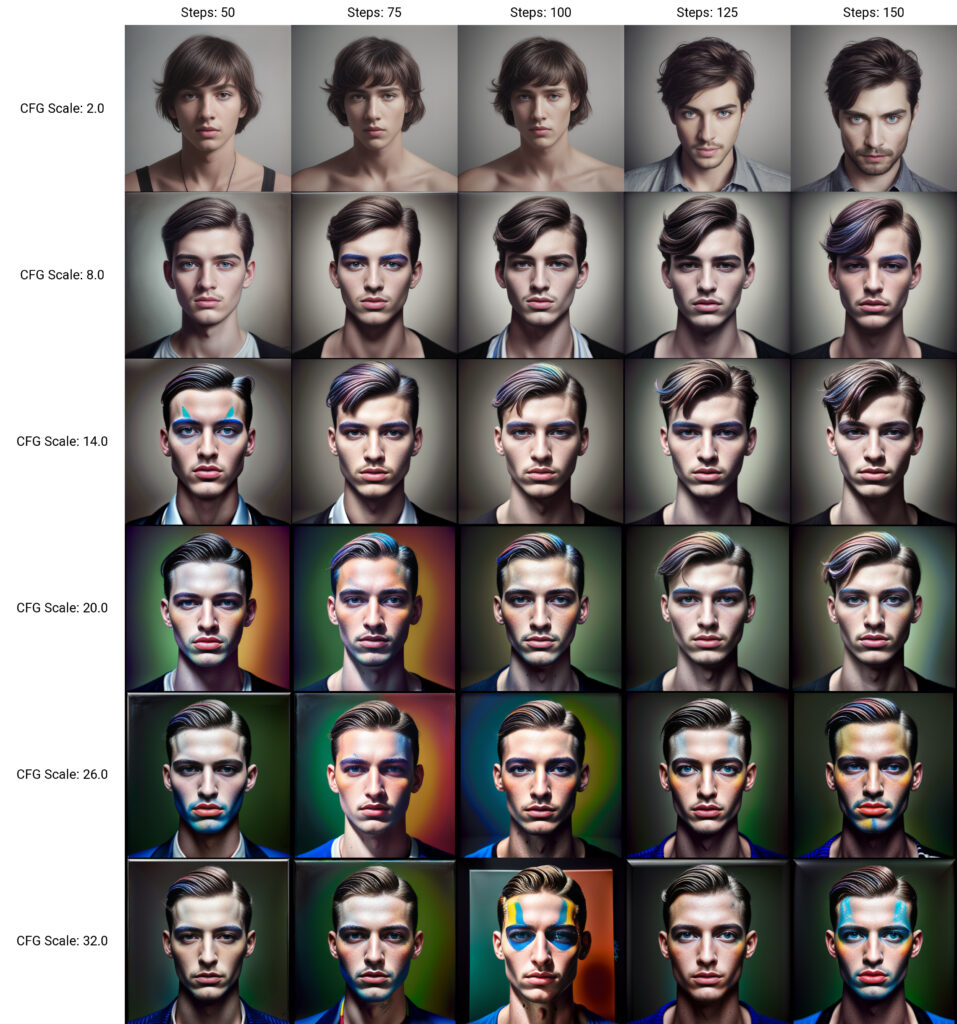

För att du ska kunna se vad skillnaden blir med olika inställningar, antal steg och cfg-skala så kan du kolla bilden nedan, min prompt för bilden är ”portrait, masculin man, photorealism, photography masterpiece, colorful”. Hur mycket som ändras kan också bero på vilken modell du använder, i detta exempel så använder jag inte originalet:

Man kan ibland också behöva skriva en negativ prompt. Dessa kan vara användbara när du vill specificera vad du inte vill ha i din genererade bild och det ger mer kontroll över resultatet. Genom att ange vad du inte vill ha kan du vägleda AI:n i att skapa bilder som bättre matchar dina preferenser och kreativa idéer. Om man dessutom kombinerar det med en tränad ”model” så kan resultatet bli så här istället:

Min prompt för denna bild är ganska enkel:

a muscular guy with a beard wearing a suit

Men jag har också fyllt i en negativ prompt för att undvika konstigheter i den genererade AI-bilden:

high contrast, large head, long neck, long body, frown, disfigured, ugly, low-res, deformed, bad anatomy, disfigured, poorly drawn face, mutation, mutated, extra limb, ugly, poorly drawn hands, missing limb, floating limbs, disconnected limbs, malformed hands, long neck, long body, ugly, disgusting, poorly drawn, mutilated, mangled

Kom ihåg att AI är superkass på att rita händer. Man kan dock förbättra det genom ett tillägg som heter ControlNet och Openpose (går att installera direkt inifrån webbgränssnittet).

Nyckelord och styrka

När man skriver sin prompt så kan man justera styrkan av ett nyckelord genom ett numeriskt värde. En siffra mindre än 1 betyder mindre viktigt och mer än 1 betyder mer viktigt. Till exempel kan du skriva dog:0.5 om hunden är mindre viktig, eller dog:1.5 om den är mer viktig. Du kan också justera styrkan av ett ord genom () eller []. Att sätta ett ord inom parenteser ökar styrkan med .1, (dog) betyder därför samma sak som dog:1.1. Att sätta ett ord inom hakparanteser minskar styrkan med .1, [dog] betyder därför samma sak som dog:0.9. Man kan också använda dubbla paranteser för att öka eller minska styrkan ytterligare.

Det kan också vara bra att kontrollera att ett nyckelord du använder har någon effekt, exempelvis om du vill efterlikna en särskild konstnär. Skriv bara namnet på konstnären och generera en bild. Om bilden liknar bilder av given konstnär så fungerar nyckelordet, om inte så kan du i princip stryka det nyckelordet helt och hållet eftersom det inte kommer att ha någon positiv effekt på resultatet.

Inställningar

sampling method, sampling steps och cfg scale är de grundläggande inställningarna som har stor betydels för hur dina AI-bilder ser ut när de kommer ut ur bruset.

”Sampling method” avgör hur bilden kommer fram ur bruset. Prova dig fram och se vilken du gillar bäst, själv föredrar jag DPM++ 2M Karras.

”sampling steps” är precis som det låter antalet steg AI:n tar för att ta fram din bild ur bruset. Olika metoder fungerar olika bra med antalet steg, vissa vill ha lägre, andra högre. Prova dig fram för att hitta rätt balans.

Hur mycket Stability AI ”lyssnar” justerar du med cfg scale. Testa olika värden och se efter vad som händer.

Exempel

Här är några exempel-bilder jag skapat för att du ska se vad som är möjligt:

Skriv en kommentar